گوگل اعلام کرد که آنها ابزار تست Robots.txt خود را در Webmaster Tools بروز رسانی کرده اند. هدف از فایل Robots.txt این است که به موتورهای جستجو بیان شود که چگونه وب سایت را شاخص گذاری کنند و اینکه هر صفحه یا دایرکتوری در کجای وب سایت قرار گرفته اند. موتورهای جستجو خزنده های خود را برای شاخص گذاری صفحات بصورت متناوب سوی وب سایت ها ارسال می کنند. همچنین در این فایل می توان تنظیم کرد که آیا موتور جستجو می تواند به یک صفحه یا دایرکتوری دسترسی داشته باشد یا خیر.

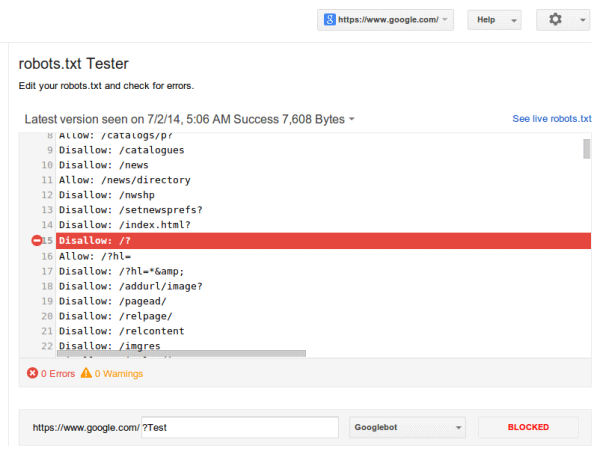

بروز رسانی Webmaster Tools شرکت گوگل قابلیت ها ی زیر را در اختیار شما قرار می دهد:

1- مشخص می کند هر خطی که در فایل Robots.txt مسدود شده است مربوط به کدام صفحه وب سایت است.

2- تغییرات در فایل Robots.txt را بررسی می کند و قبل از اینکه این فایل را Live نماید ابتدا آن را تست می کند.

3- گوگل نسخه های قدیمی Robots.txt وب سایت شما را جهت بررسی در اختیار شما قرار می دهد.

در شکل زیر این قابلیت ها برجسته شده اند: